INDEX

ChatGPT、Gemini、Claude、NotebookLM、Perplexity、GenSpark、Feloといった主要な生成AIサービスを対象に、ユーザーが入力したデータがAIモデルの学習に利用されるのか調査しました。各サービスの公式サイトに掲載されている2025年3月時点でのプライバシーポリシー、利用規約、FAQより確認しました。日々変化する情報のため、気になる点は必ず、公式サイトをご覧ください。

ChatGPT(OpenAI)

| プラン | 入力データの学習利用 | アップロードファイルの利用 | ユーザーによるコントロール | その他 |

|---|---|---|---|---|

| 無料版 |

|

|

|

|

| ChatGPT Plus |

|

|

|

|

| Teamプラン |

|

|

|

|

| Enterpriseプラン |

|

|

|

|

ChatGPTは、ユーザーが入力したテキストやアップロードしたファイルを活用し、AIモデルを改善する仕組みを備えています。ただし、ビジネス向けプラン(Team/Enterprise)では、デフォルトで学習に使用しない設定が採用されており、企業の機密情報を守りながら利用できるようになっています。一方、個人ユーザー向けには「モデル改善に貢献する」オプションがデフォルトでオンになっており、設定をオフにしない限りはアップロードしたファイルや入力データが学習に利用される場合があります。ユーザーによる削除やオプトアウトを行えば、一定期間(最大30日)でOpenAIのシステムからデータが削除される仕組みが提供されています。

入力データの学習への利用(無料版および有料版)

無料版/ChatGPT Plus(個人向け)

- デフォルトで、ユーザーの入力データ(テキストやファイルを含む)がAIモデルのトレーニングに使われる可能性があります。

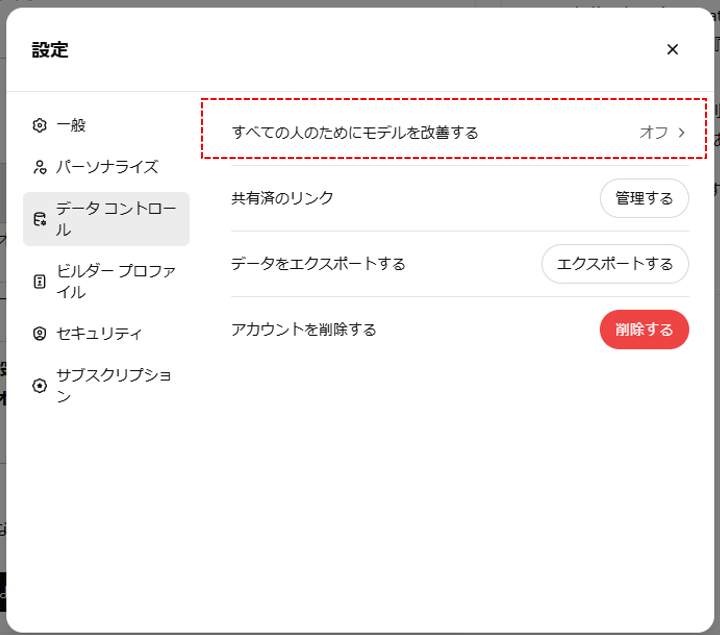

- 設定メニュー(「データ管理」など)から「みんなのためにモデルを改善する」オプションをオフにすることで、新しい会話やファイルがトレーニングに利用されなくなります。

- ただし、オプトアウト前に送信されたデータは学習に使用されている可能性があります。

Team/Enterprise(ビジネス向け)

- デフォルトでトレーニングには使用されません。

- 組織が明示的にオプトインしない限り、アップロードされたファイルや入力データが学習に利用されることはありません。

- 管理者がデータ保持ポリシーを細かく設定でき、最短30日などのカスタム保持期間を指定できます。

アップロードされたファイルの取り扱いと学習への利用

- 個人ユーザー(無料/Plus)では、アップロードしたファイルもトレーニングに利用される可能性があります。テキストだけでなく、画像やPDFなどをアップロードした場合も同様です。

- ビジネス向けプラン(Team/Enterprise)では、アップロードファイルが自動的に学習へ回されることはありません。

- ユーザーがチャットやアカウントを削除すると、通常は30日以内にファイルを含むデータがOpenAIのバックエンドから削除されます。ただし、セキュリティや法的理由で保持が必要な場合など、例外もあります。

ユーザーによるコントロール

オプトアウト設定

個人ユーザーは設定画面から「みんなのためにモデルを改善する」オプションをオフにすることで、以後の会話やアップロードファイルが学習に利用されないようにできます。

チャット/アカウントの削除

- チャットを削除すると、その会話と関連するファイルは最大30日でシステムから削除されます。

- アカウントを削除すれば、すべての会話やファイルが同様に削除対象となります。

ビジネスプランのカスタムポリシー

TeamやEnterpriseの場合、管理者が保持期間やオプトイン設定を細かく制御できます。

高度なデータ分析(ADA)の保持

高度なデータ分析を通じて処理されたファイルは、無料版/有料版などのプランによって保持期間が異なる場合があります。

Gemini (Google)

| プラン | 入力データの学習利用 | アップロードファイルの利用 | ユーザーによるコントロール | その他 |

|---|---|---|---|---|

| Gemini for Workspace (Google Workspaceアカウント) |

|

|

|

|

| Gemini Apps (個人アカウント, 無料/有料) |

|

|

|

|

Googleが提供する「Gemini」は、AIモデルを活用した新世代のサービスです。Google Workspaceアカウントを通じて利用する「Gemini for Workspace」と、個人アカウントで使う「Gemini Apps」では、データの扱い方が一部異なります。企業向けでは厳格なプライバシー保護が適用され、個人向けでは匿名化や一時的な保存など、ユーザーデータの取り扱いに配慮した機能が用意されています。

入力データの学習への利用(無料版および有料版)

Gemini for Workspace(Google Workspaceアカウント)

- ユーザーの明示的な許可がない限り、AIモデルのトレーニングには使われません。

- 企業のセキュリティポリシーや管理体制を活かせるため、機密データの保護に適しています。

個人アカウント(Gemini Apps)

- プロンプトや応答、フィードバックなどのデータは、Googleのサービスや機械学習モデルの品質向上に使われる可能性があります。

- 匿名化された状態で、人間の担当者によるレビューが行われることがありますが、レビュー前にアカウントから切り離されるとされています。

- 「Gemini Appsアクティビティ」設定がオフでも、最大72時間はサービス提供やフィードバック対応のため会話が保存されます。

アップロードされたファイルの取り扱いと学習への利用

- 2025年3月時点で、個人向けGeminiにアップロードしたファイルはAIモデルの学習に使われていないと明言されています。

- ただし、フィードバックとして明示的に提供した場合は、トレーニングに利用される可能性があるため注意が必要です。

- 日常的に文書や画像を共有する場合は、どのようなデータを含むかをしっかり確認しましょう。

ユーザーによるコントロール

Gemini Appsアクティビティ設定

- 会話がモデルの改善に利用されるかどうかをコントロール可能。

- オフにしていても、サービス提供やフィードバック対応で最大72時間は会話が保存されます。

フィードバックの扱い

- フィードバックとして送信したデータはモデルの学習に使われる可能性があります。

- 機密情報を含む場合は、送信前によく確認しましょう。

無料版と有料版における違い

無料版と有料版のGemini Appsで、AIモデルへのデータ利用ポリシーに大きな差はないとされています。そのため、アクセスレベルの違いによってデータ利用が極端に変わることはなく、基本的なルールは共通しているようです。

Claude(Anthropic)

| プラン | 入力データの学習利用 | アップロードファイルの利用 | ユーザーによるコントロール | その他 |

|---|---|---|---|---|

| 無料版/Claude Pro |

|

|

|

|

| Claude for Work/Enterprise |

|

|

|

|

AnthropicはAIサービス「Claude」を展開するにあたり、安全性・倫理性・プライバシーの3つをとても重視しています。特に、ユーザーの明示的な許可がない限り、コンシューマー向けサービスやベータ版でやり取りされたデータをAIモデルの学習に使わないことを明確に打ち出している点が特徴です。この方針によって、機密性の高い情報を扱う場面や、厳格なデータ保護を求めるユーザーから注目を集めています。

入力データの学習への利用(無料版および有料版)

無料サービス(Claude.aiやClaude Pro)

- ユーザーのプロンプトや出力は、最長90日でバックエンドから自動削除されるポリシー。

- 会話を手動で削除すれば、履歴からすぐに消え、最大30日以内にバックエンドからも完全削除。

エンタープライズ向け(Claude for Work/Enterprise)

- 組織ごとに独自のデータ保持ポリシーを設定でき、最短30日などの期間を指定できる。

- 一般ユーザーでも90日での自動削除ポリシーがあるため、データが長期的に残るリスクを低減している。

アップロードされたファイルの取り扱いと学習への利用

明示的な同意または特定の例外なしに、アップロードされた画像をトレーニングに使用しない。

ユーザーによるコントロール

- 会話の削除機能: 削除した会話は履歴から直ちに消え、最大30日以内にバックエンドからも削除。

- エンタープライズ向けポリシー: 組織の要件に合わせてデータ保持期間の細かい設定が可能。

- コンシューマーユーザー向け: 90日での自動削除ポリシーが適用されるため、オプトアウトの手間が最小限で済む。

NotebookLM(Google)

| プラン | 入力データの学習利用 | アップロードファイルの利用 | ユーザーによるコントロール | その他 |

|---|---|---|---|---|

| 個人アカウント |

|

|

|

|

| Workspace/Educationアカウント |

|

|

|

|

GoogleのNotebookLMは、ユーザーの個人データをAIモデルのトレーニングに一切使用しないという明確な方針を掲げています。アップロードした文書や作成したノートは必要に応じて保存されますが、クエリ自体は保存されないため、データの扱いを細かくコントロールできる点が特長です。さらに、個人用アカウントとWorkspace/Educationアカウントでプライバシー保護の仕組みが異なるのもポイントです。

入力データの学習への利用(無料版および有料版)

NotebookLMでは、ユーザーの入力データ(クエリや文書など)をAIモデルのトレーニングに利用することはありません。そのため、「無料版/有料版」での違いは特にないと考えられます。個人アカウントでもWorkspace/Educationアカウントでも、ユーザーデータが勝手に学習に使われることはない仕組みです。

ただし、個人アカウントでNotebookLMに対するフィードバックを送る場合は、人間のレビュー担当者による確認が行われる可能性があります。これはトラブルシューティングやサービス改善を目的とした限定的なプロセスであり、どのような内容を送るかはユーザー自身でよく判断することが求められます。

アップロードされたファイルの取り扱いと学習への利用

アップロードした文書やノート、音声概要は、ユーザーが情報を操作・管理できるように保存されますが、NotebookLMのAIトレーニングには使われません。ユーザーが削除を行わない限りは保持されますが、必要に応じていつでも削除できるため、データ管理の自由度が高いのが特徴です。また、Workspace/Educationアカウントを使っている場合は、このアップロードデータを人間のレビュー担当者が確認することはないとされています。

ユーザーによるコントロール

NotebookLMでは、ユーザーがアップロードした文書やノートを自分で削除しない限り保持されます。一方で、クエリは記録されないため、ユーザーがどのような問い合わせをしたかはプラットフォーム側に基本的に残らない設計です。個人アカウントの場合は、フィードバックを送るときにのみ、内容をレビューされる可能性があるという点に注意しましょう。Workspace/Educationアカウントではそうしたレビューは行われず、より強固なプライバシー保護が適用されます。

Perplexity AI

| プラン | 入力データの学習利用 | アップロードファイルの利用 | ユーザーによるコントロール | その他 |

|---|---|---|---|---|

| 無料版/Pro |

|

|

|

|

| エンタープライズ |

|

|

|

|

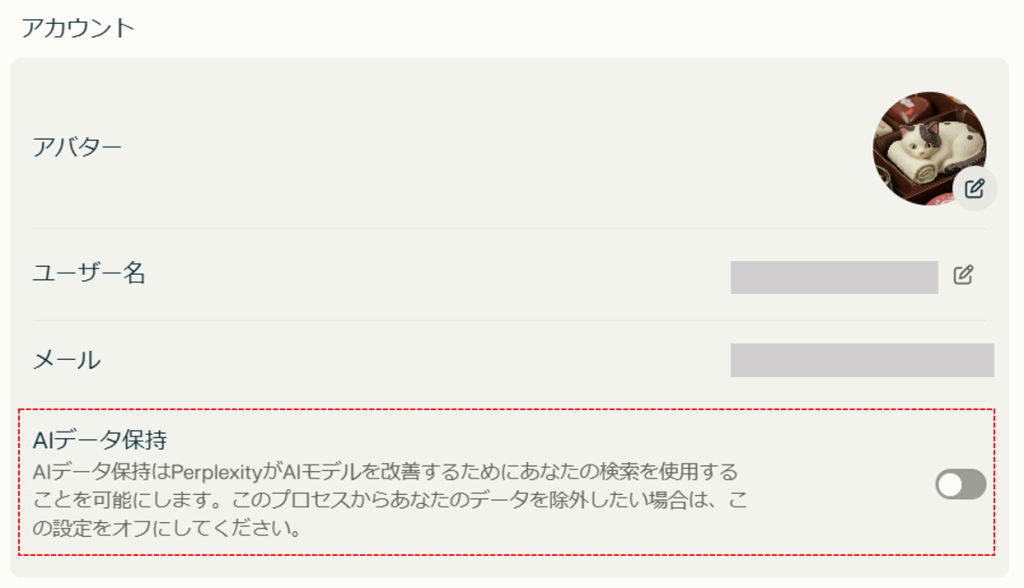

Perplexity AIは、検索クエリとフィードバックを使ってサービスの精度や利便性を高める仕組みを導入しています。ただし、ユーザーはプロフィール設定から「AI Data Usage」をオフにすることで、自分の検索クエリがモデル改善に使われるのをオプトアウトできるようになっています。また、アップロードされたファイルは特定の会話の応答にのみ使用され、30日後にはアクセスできなくなるなど、プライバシー保護の取り組みが行われています。

入力データの学習への利用(無料版および有料版)

Perplexity AIの無料版とPro版では、ユーザーの検索クエリがデフォルトでモデル学習に利用される可能性がありますが、前述のオプトアウト設定を使うことで回避できます。一方、エンタープライズプランではユーザーデータがAIのトレーニングに使われないことが明示的に保証されています。この点で、企業ユーザーはより強力なプライバシー保護を受けられます。

アップロードされたファイルの取り扱いと学習への利用

ユーザーがアップロードしたファイルの内容は、会話スレッド内の質問にカスタマイズされた回答を提供するためだけに使われます。Perplexityはファイルを他の目的でアクセス・共有しないと明言しており、30日経過するとファイルの内容は参照できなくなる仕組みです。ただし、同じ会話スレッド内の「質問と回答の履歴情報」は残る可能性がある点に注意が必要です。

ユーザーによるコントロール

ユーザーは、アカウント設定で検索クエリやフィードバックの学習利用をオプトアウトでき、アカウント削除を行えば30日以内にサーバーからデータが削除されます。これらの機能によって、ユーザーは自分のデータがどのように使われるかをコントロールしやすくなっています。

GenSpark

| プラン | 入力データの学習利用 | アップロードファイルの利用 | ユーザーによるコントロール | その他 |

|---|---|---|---|---|

| 無料版/有料版 |

|

|

|

|

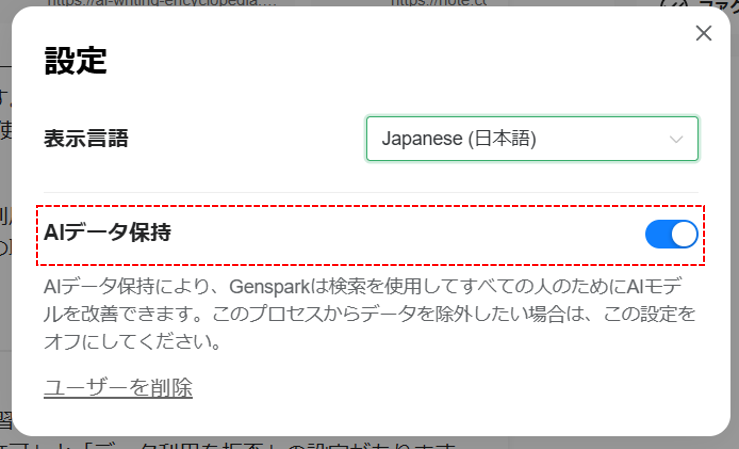

Gensparkは、ユーザーの入力データをもとにAIがリアルタイムで検索結果を提供し、「Sparkpages」というカスタムページを生成するサービスです。ユーザーがログインしている場合は設定ページで「AIデータ保持」を無効化できる一方、ログインしていない場合はユーザーの検索データがAIモデルの改善に使われる可能性があります。写真を含むアップロードファイルは特定の目的(仮想試着など)に使用されると明言されていますが、それがAI学習に使われるかどうかは明確には記載されていません。

入力データの学習への利用(無料版および有料版)

無料版・有料版ともに、ユーザーがログインし設定を変更しない限り、検索データなどがAIモデルの改善に利用される可能性があります。ただし、ログイン状態のユーザーは「AIデータ保持」をオフにでき、学習利用を制限することができます。ファイルアップロードやエージェント利用履歴なども、同様にユーザーが意図的にオフにしない限りは学習対象になり得ると考えられます。

アップロードされたファイルの取り扱いと学習への利用

アップロードしたファイルは、サービス提供に必要な範囲で利用されるとされています。特に写真については、仮想試着のためだけに使用され、顔認識や生体認証データの抽出は行われないと明言されています。ただし、アップロードされたファイルがAIモデルの学習に使われるかどうかについては、はっきりとした説明が見当たりません。アカウントが有効である限りファイルが保管される可能性がある一方、アカウント削除時には30日以内にサーバーから削除されるとされており、ユーザーは必要に応じて削除リクエストを行うことができます。

ユーザーによるコントロール

ユーザーは設定画面でAI向けのデータ収集を無効にすることができ、またアカウント削除をリクエストすれば、30日以内に個人データが削除されます。ただし、削除リクエストを行わない限り、アップロードしたファイルが自動的に削除されるタイミングや詳細は明確に示されていないため、気になる場合は明示的に連絡を取って削除を依頼する必要があるかもしれません。

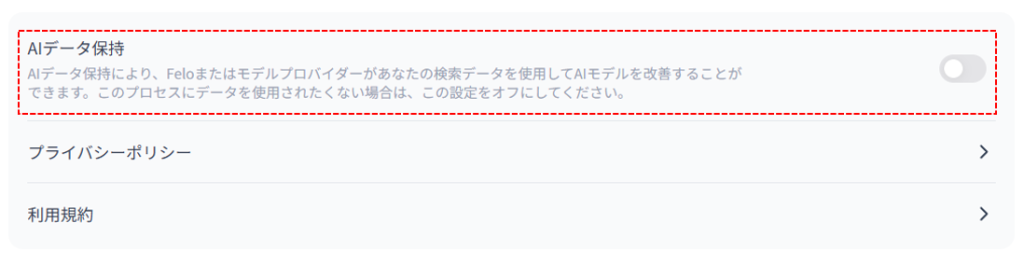

Felo

| プラン | 入力データの学習利用 | アップロードファイルの利用 | ユーザーによるコントロール | その他 |

|---|---|---|---|---|

| 無料版 |

|

|

|

|

| Felo Pro(有料版) |

|

|

|

|

Felo AIは、東京に拠点を置くAI検索エンジンで、多言語での情報検索と学術リソースの統合に注力しています。ユーザーが入力したデータやアップロードしたファイルは、回答を作成したり関連タスクを実行したりするためだけに使われ、AIモデルの学習には用いられません。無料ユーザーは7日間、有料プラン(Felo Pro)のユーザーはカスタマイズされた保持設定を通じて、ファイルを安全に管理できます。機密性の高い文書を扱うユーザーにとっても、情報漏えいリスクが最小限に抑えられる構造が魅力です。

入力データの学習への利用(無料版および有料版)

Feloは無料・有料を問わず、ユーザーの入力データをAIモデルのトレーニングに使わない方針を明示しています。そのため、利用者はプランを選ばずに安心して検索やファイルのアップロードが可能です。また、APIを介した連携でも同じポリシーが適用される点は大きなメリットです。

アップロードされたファイルの取り扱いと学習への利用

ユーザーがアップロードしたファイルは、回答生成などのサービス提供に必要な範囲でのみ使用され、第三者や他の目的への転用は行われません。無料ユーザーの場合は7日間の保持期間後に完全削除され、有料プランではユーザーアカウント内で管理されるだけで、外部への流出やモデル学習への転用はありません。このように、ユーザーごとに明確なデータ管理ルールが設定されています。

ユーザーによるコントロール

ユーザーは、Felo AI上にアップロードしたファイルや検索履歴を自分で管理できます。無料プランではファイルが自動的に7日で削除されますが、必要に応じて早めの削除も可能です。有料プランでは、保持期間やデータ管理方法を柔軟に調整できる場合があります。Feloのプライバシーポリシーによると、「AIモデルのトレーニングに利用しない」ことが保証されており、利用者は自分のデータがどのように使われるかをはっきりと理解した上でサービスを利用できます。